开云sports 2026年,安全正在成为AI选型的“新标配”

文 | 产业家

AI是否信得过派鸿沟进入中枢业务,关节不在于模子能力又进步了若干,而在于一朝出现问题,系统能否被实时停驻,过程能否被回首,包袱能否被透露界定。在这些问题惩办之前,安实足会是AI落地过程中最现实、也最难绕开的门槛。

报复一朝被AI变成一种“产能”,攻防磋商濒临的则是结构性失衡。

这种变化仍是启动在现实中显现。

12月22日22时,快手遭受大鸿沟黑灰产报复,监测数据夸耀峰值时段约有1.7万个被控僵尸账号同步开播推送色情低俗内容。事实上,报复手法并不新奇,信得过蜕变战局的是AI带来的“杠杆效应”,即在AI的加捏下,报复资本降到极低,报复遵循反而被成倍放大,退守方的响应能力初次被压制在敌手之下。

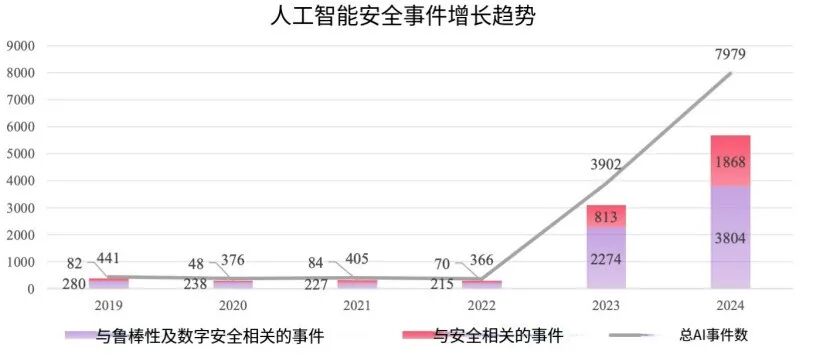

这并非孑然事件。一组来自OECD的AI事件监测数据夸耀,2024年的AI风险事件总和约是2022年的21.8倍,2019‑2024年间记载的事件中约74%与AI安全磋商,安全与可靠性事件较2023年增长83.7%。

在这种配景下,安全的逻辑正在被动重写。

昔日,企业在弃取大模子或Agent职业商时,性能、价钱、生态险些自然排在最前边,安全更多被视为一种过后盾救能力。但在一轮又一轮实战之后,越来越多企业启动鉴定到,一朝将业务历程、用户触点乃至决策权交给AI,安全就不再是“过后诸葛亮”的选项,而是必须前置到选型阶段。

{jz:field.toptypename/}而这场微妙的回转,正在倒逼企业再行排序与AI磋商的所有决策优先级。一组来自阿里云与Omdia皆集发布AI安全阐清醒示,企业将安全与数据阴事视为AI主要阻难的比例,从2023年11%激增至2024年43%。

安全,第一次从“可选项”变成了AI能否落地的前置条件。

一、从探索到深水区,AI安全成为落地前提2025年,企业对“安全”的明锐度正赶紧放大。

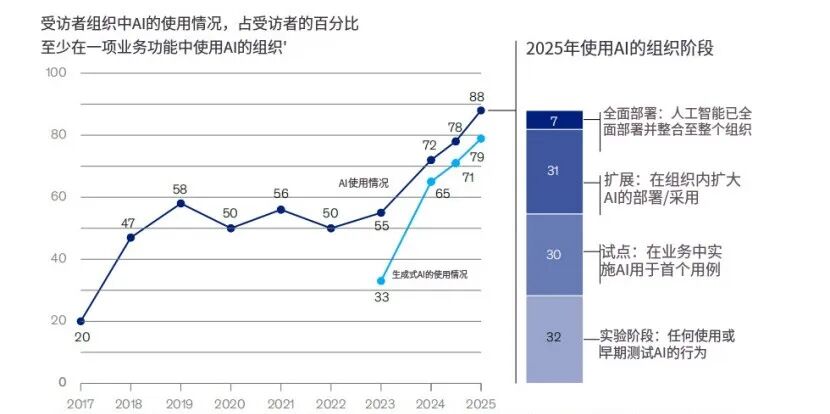

进入2025年,AI已从本事探索阶段迈入企业业务的深度应用场景。麦肯锡《ThestateofAIin2025》阐清醒示,88%的受访企业暗示已在至少一个业务职能中使用AI本事,比昨年整整朝上了10个百分点。

而跟着AI使用范围和能力的挪动,企业对安全的明锐度正在赶紧放大。要知说念早期的AI应用多停留在撰写案牍、内容生成及浅易数据分析等扶持性场景,这类应用即便出现误判或偏差,对业务本人的损伤有限。可是跟着AI加快落地,其启动被赋予更强的权限,举例读取业务数据、调取里面系统、参与历程决策等。

Gartner量度,到2028年33%的企业软件将包含AI代理功能,可自主完成15%的东说念主类日常职责决策,权限膨胀带来的风险敞口捏续扩大。

在这种配景下,AI一朝失控,就不再是一个输出造作那么浅易,而可能会径直裸露明锐数据或影响出产与走动历程。

这种担忧并非说念听途看。一家来自HarmonicSecurity的分析夸耀,在2025年二季度,企业使用的千般GenAI平台中,超越4%的对话、20%以上的上传文献都包含明锐企业数据。这意味着一朝管控不到位,风险会在日常使用中被捏续放大。

也正因为如斯,安全不再是无关紧要的选项。字据赛博商讨院发布的《2025大家实在AI治理与数据安全评释》夸耀,模子的准确性与巩固性是企业最垂青的身分,紧随自后的即是占据79%数据使用的合规性与阴事保护、和占据54%的总领有资本与投资酬报比。安全,正在被主动前移到样貌启动和本事选型阶段,成为企业AI落地的关节前提。

这小数,仍是成为头部企业的共鸣。

一则大家16家头部AI企业签署的“前沿东说念主工智能安全快乐”中,明确提议“设立和部署前沿AI模子和系统时需有用识别、评估和管理风险,设定不可容忍风险的阈值”,印证了安全已成为行业共鸣的中枢目的。

这种风险感知,具体还体咫尺企业弃取互助伙伴和鼓舞样貌的现实历程中。

举例,一家大型制造企业IT负责东说念主向产业家浮现,昔日唯有模子在试点阶段跑通业务场景,就不错进入下一阶段评估。但在最新一轮Agent能力测试中,该企业要求测试包括指示注入、逃狱风险、越权调用等负面测试用例,不然该决议径直无法进入评审门径。

再比如,有证券行业的CIO在里面邮件中明确要求:AI平台必须守旧企业稀奇部署或VPC进击,并谢绝任何业务数据用于第三方测验,不然不予进入第二轮评估。这一类条件的出现,斗鱼体育中国官网入口响应出企业在第一阶段,就启动把数据安全和探访收敛,行为了筛选供应商的中枢条件。

不错发现,安全不再是一个孑然的资本中心,而是决定AI能否被平时经受、实在赖运营的中枢条件。更伏击的是,安全也正成为企业生态中信任的最伏击货币。在互助伙伴弃取、行业互助框架、客户条约谈判中,AI安全保险仍是成为谈判桌上的中枢条件之一,致使径直影响条约签约与生意互助成败。

在这其中,谁能在遵循红利与安全红线之间找到更稳当的均衡,谁才有资历鄙人一阶段的AI竞争中信得过跑在前边。

二、安全“前移”AI选型,正在蜕变安全竞争形状在2025年,国内初次进行了AI大模子实网众测,发现了281个安全间隙,其中大模子特有间隙177个,占比63%。这些间隙包括指示注入、逃狱报复、挣扎样本等传统安全体系无法掩饰的挟制类型。

传统安全厂商的计谋,仍是无法承受AI时间的新报复妙技。

跟着AI本事的普及透顶蜕变了收集报复的底层逻辑。安全厂商要作念的事情越来越多,但价值越来越难量化。但这不是厂商能力的问题,而是产业结构转向包袱共担。这对产业的影响是深刻的。一方面,安万能力将不可幸免地被“内嵌化”,融入云平台、模子底座、业务系统,零丁请托的空间被不停压缩;另一方面,安全厂商淌若无法提供治理层面的价值,就会被边缘化为某种可替换能力模块。

而思要幸免成为被内化的那一个,则必须让我方成为系统运行过程中绕不开的一环。

以360、奇安信、肯定服、绿盟科技为代表的传统收集安全厂商,全体计谋并非推倒重来,而是将AI视为能力增强器,弃取在既有安全家具与平台中镶嵌大模子能力。

以360为例,其在2023年淡雅发布“AI原生安全大模子”,声称基于超越40PB的安全样本数据、数十年攻防挣扎教授,用于APT报复检测、挟制谍报自动挖掘和安全事件研判。据其败露,在APT告警去重和误报压缩方面,模子扶持分析可将东说念主工分析资本裁汰50%以上。

这一皆径的上风相等清醒。字据赛迪照拂人数据,中国政企收集安全阛阓中,头部厂商在政府、金融、动力等行业的存量掩饰率广泛超越60%,开云sports不错说传统厂商紧紧掌控政企安全进口。

与传统厂商不同,阿里云、腾讯云、百度智能云等云职业商弃取从基础步调与平台层脱手,将安万能力径直“内建”到AI的全人命周期中。

在现实落地上,这类厂商广泛在模子托管、推理调用、插件接入、Agent编排等门径,默许启用安全收敛计谋,并将身份、权限、数据、模子版块与AI使用过程进行强绑定。举例阿里云在其大模子职业平台中,将API调用鉴权、Prompt审计、RAG数据探访权限行为默许能力;腾讯云在企业大模子平台中,将模子调用与企业IAM、日记审计、数据分级买通;百度智能云则在Agent构建框架中收敛外部器具调用权限,裁汰模子“越权施行”风险。

这类厂商由于安万能力被镶嵌到主旅途中,其角落资本险些为零。尤其在Prompt注入、RAG检索羞耻、Agent器具滥用等新式报复面上,平台级经管清醒比过后检测更具鸿沟遵循。

另一类伏击玩家,是聚焦细分场景的垂直安全厂商。以数好意思科技为例,其弥远深耕内容安全、反诈骗、黑产举止建模。在生成式AI场景下,数好意思将原有的风控模子挪动至AI滥用治理中,用于识别坏心Prompt、自动化期骗剧本生成、装假内容批量生成等举止。据公开案例,其在部分应对与内容平台中,AI滥用识别的掷中率已高于90%。

这类厂商的上风在于专科能力聚焦,模子挣扎教授深。能高风险场景中提供不可替代价值。

连年来,也有一批原生AI安全厂商正快速崛起。这类公司并非从传统安全体系演进而来,而是径直聚焦模子内容与智能体层,从绸缪阶段裁汰风险。这类厂商常常本事迭代快、对新式挣扎报复高度明锐,在模子级安全上具备先发上风。

抽象来看,在生成式AI的捏续压力下,安全产业的单干正在重排。不同位置的厂商,正从各自的切口启航,共同托起一套亟需重构、尚不决型的“新安全体系”。

三、AI安全的能力范畴:无法“清零”,只可“控损”当安全被推到AI选型的前台,一个绕不开的问题也随之浮现:安全是不是越强越好?是否存在弥散安全?

谜底并不乐不雅。OpenAI曾在公开商讨中给出过一组判断:在AI浏览器、Agent等场景中,指示注入属于结构性风险。即便捏续加固,安全系统也无法作念到100%阻难,最优景况,最优珍惜仅能将报复成遵循压至5%-10%。

这小数,在数好意思科技CTO梁堃的判断中雷同明确:“面前竣事对黑灰产的百分之百阻断,并不现实。”

不外,需要深远的是,并非所有AI场景都把安全放在第一位。

在无数探索性与边缘业务中,企业依然会弃取遵循优先。举例里面学问助手、营销内容生成、数据分析Copilot,这些场景要么不战役明锐数据,要么不具备施行权限,即便模子出现偏差,风险也相对可控。在这些场景中,企业更关切的是插足产出比,而非安全治理的完备性。

信得过发生鼎新的,是AI启动进入中枢业务链路之后。在波及客户数据、走动决策、出产诊治、风控审核等场景中,企业常常会赶紧收紧计谋,将安全前置为硬经管。

这种领会回荡,径直带来了三种清醒的使用格式变化。

第一种转向,是从“能跑”到“能控”。

在安全前置后,企业广泛启动收敛模子可触达的数据范围。正本不错全量接入的数据,被拆解为分级、分域、分场景使用;RAG检索不再“全库调回”,而是终结在经过审核的学问迫临中。这可能会导致模子在某些任务上的准确率可能下落,调回率受到影响,业务侧不得不插足更多元气心灵进行数据治理与结构化整理。

不外,这并非本事倒退。对企业而言,宁肯就义部分遵循,也不肯承担不可控风险。

第二种转向,是从“可用”到“可审”。

跟着AI被纳入淡雅出产环境,是否具备审计与留痕能力,成为一说念关节门槛。Prompt是否可回首?模子援用了哪些检索内容?Agent调用了哪些器具、在什么时期、以什么权限施行?这些正本属于工程细节的问题,启动被写进验收清单。

这会径直导致系统复杂度和资本高潮,比如调用链变长、蔓延加多、算力浮滥提高。但在ToB场景中,可诠释性常常比极致遵循更伏击。能弗成说明晰发生了什么,启动成为比跑得快不快更伏击的目的。

第三种转向,则是从“自动化”到“半自动化”。

在许多中枢业务场景中,企业并未弃取让Agent全自动施行,而是选拔“建议+东说念主审+施行进击”的模式。AI给出决策建议,东说念主类完成最终证据,关节操作与出产系统进击。这种模式昭着拉长了历程,也收敛了诊治鸿沟,但它合乎面前企业对风险的容忍度。

在这一阶段,安全的作用不再是进步阻难率,而是细心系统失控。也恰是在这么的实践中,企业缓缓酿成了透露的里面分层。边缘业务不错容忍更多不祥情味,安全要求相对靠后;中枢业务必须安全前置,且允许的自动化进程清醒更低。

值得防范的是,这种分层并非一成不变。跟着安万能力的教育、治理教授的积蓄,部分正本需要东说念主工介入的门径,可能会徐徐放权给AI。

从这个角度看,AI时间的安全,仍是不再是“有莫得”的问题,而是“管到什么进程”的问题。通过收敛数据、收紧权限、引入审计,把不可幸免的风险收敛在企业不错经受的范围之内。这种安全实践的深化,不仅蜕变了企业自身对AI治理的旅途,也使得所有这个词产业对AI安全的领会正在发生根人性转向。

写在临了:不错预料,在格外长的一段时期里,AI安实足不可能靠一次性决议透顶惩办。

在此过程中,企业对AI的使用会捏续分化,即边缘业务更垂青遵循和产出,而中枢业务则会保捏弥远审慎。自动化不会浅易地“一步到位”,而是围绕权限收敛、审计机制和包袱范畴徐徐鼓舞。AI的能力会不停增强,但它被允许自主决策的空间,并不会势必同步扩大。

对安全产业来说,这雷同是一轮弥远诊治。单纯依赖过后检测的价值将捏续下落,或者参与系统绸缪、权限治理和运行经管的能力,反而会变得越来越关节。安全不再仅仅一个零丁家具,而更像是AI系统运行的前提条件。

从这个角度看,AI是否信得过派鸿沟进入中枢业务,关节不在于模子能力又进步了若干,而在于一朝出现问题,系统能否被实时停驻,过程能否被回首,包袱能否被透露界定。

在这些问题惩办之前,安实足会是AI落地过程中最现实、也最难绕开的门槛。

备案号:

备案号: